Apache Hadoop je veľké dátové riešenie na ukladanie a analýzu veľkého množstva dát. V tomto článku podrobne popíšeme zložité kroky nastavenia Apache Hadoop, aby ste s Ubuntu začali čo najrýchlejšie. V tomto príspevku nainštalujeme Apache Hadoop na Ubuntu 17.10 stroj.

Verzia Ubuntu

V tejto príručke budeme používať Ubuntu verzie 17.10 (GNU / Linux 4.13.0-38-generický x86_64).

Aktualizácia existujúcich balíkov

Na spustenie inštalácie pre Hadoop je potrebné, aby sme náš stroj aktualizovali o najnovšie dostupné softvérové balíčky. Môžeme to urobiť pomocou:

sudo apt-get update && sudo apt-get -y dist-upgradePretože Hadoop je založený na Jave, musíme si ho nainštalovať na náš stroj. Môžeme použiť ktorúkoľvek verziu Java nad Java 6. Tu budeme používať Java 8:

sudo apt-get -y nainštalovať openjdk-8-jdk-headlessSťahovanie súborov Hadoop

Na našom stroji teraz existujú všetky potrebné balíčky. Sme pripravení stiahnuť požadované súbory Tado Hadoop, aby sme ich mohli začať nastavovať a spustiť ukážkový program aj s programom Hadoop.

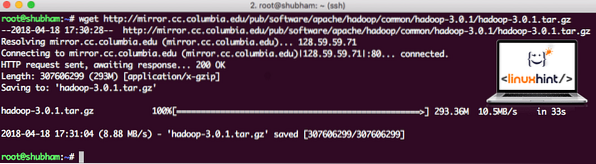

V tejto príručke budeme inštalovať Hadoop v3.0.1. Stiahnite si príslušné súbory pomocou tohto príkazu:

wget http: // zrkadlo.cc.columbia.edu / pub / software / apache / hadoop / common / hadoop-3.0.1 / hadoop-3.0.1.decht.gzV závislosti od rýchlosti siete to môže trvať až niekoľko minút, pretože veľkosť súboru je veľká:

Sťahuje sa Hadoop

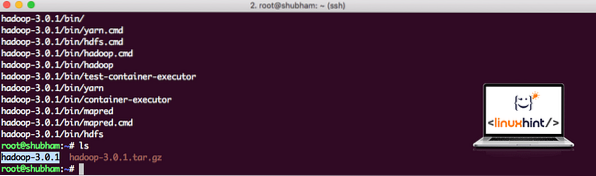

Najnovšie binárne súbory Hadoop nájdete tu. Teraz, keď máme stiahnutý súbor TAR, môžeme rozbaliť aktuálny adresár:

tar xvzf hadoop-3.0.1.decht.gzBude to trvať niekoľko sekúnd, pretože archív má veľkú veľkosť:

Archivácia Hadoop bola zrušená

Bola pridaná nová skupina používateľov Hadoop

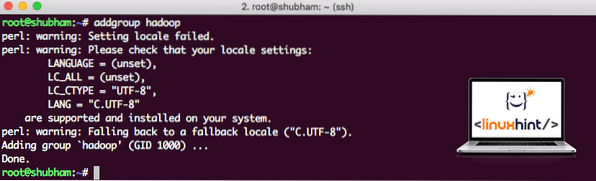

Pretože Hadoop pracuje cez HDFS, nový systém súborov môže narušiť náš vlastný súborový systém aj na stroji Ubuntu. Aby sme sa vyhli tejto kolízii, vytvoríme úplne samostatnú skupinu používateľov a pridelíme ju spoločnosti Hadoop, aby obsahovala jej vlastné povolenia. Týmto príkazom môžeme pridať novú skupinu používateľov:

addgroup hadoopUvidíme niečo ako:

Pridáva sa skupina používateľov Hadoop

Sme pripravení pridať nového používateľa do tejto skupiny:

useradd -G hadoop hadoopuserVezmite prosím na vedomie, že všetky príkazy, ktoré spúšťame, sú ako samotný užívateľ root. Pomocou príkazu aove sme boli schopní pridať nového používateľa do skupiny, ktorú sme vytvorili.

Aby sme používateľom Hadoopu umožnili vykonávať operácie, musíme mu tiež poskytnúť prístup root. Otvor / etc / sudoers súbor s týmto príkazom:

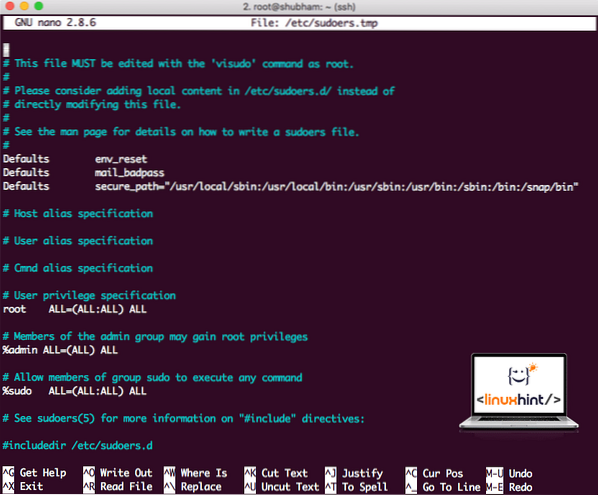

sudo visudoPredtým, ako niečo pridáme, bude súbor vyzerať takto:

Sudoers súbor pred pridaním čohokoľvek

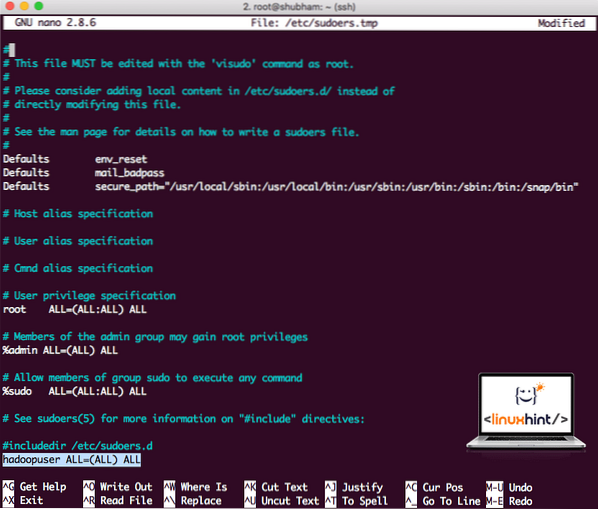

Na koniec súboru pridajte nasledujúci riadok:

hadoopuser ALL = (ALL) ALLTeraz bude súbor vyzerať takto:

Sudoers súbor po pridaní používateľa Hadoop

Toto bolo hlavné nastavenie poskytovania platformy Hadoop na vykonávanie akcií. Teraz sme pripravení nastaviť klaster Hadoop s jedným uzlom.

Nastavenie jedného uzla Hadoop: samostatný režim

Pokiaľ ide o skutočnú silu Hadoopu, je zvyčajne nastavený na viacerých serveroch, aby bolo možné škálovať ho nad veľké množstvo súborov údajov prítomných v Systém distribuovaných súborov Hadoop (HDFS). To je obvykle v poriadku s ladiacimi prostrediami a nepoužíva sa na produkčné použitie. Aby bol proces jednoduchý, vysvetlíme si tu, ako môžeme vykonať nastavenie jedného uzla pre Hadoop.

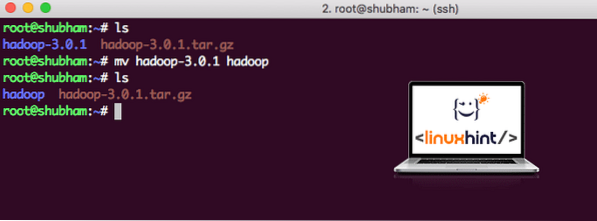

Po dokončení inštalácie Hadoopu tiež spustíme vzorovú aplikáciu na Hadoop. Odteraz je súbor Hadoop pomenovaný ako hadoop-3.0.1. premenujeme ho na hadoop pre jednoduchšie použitie:

mv hadoop-3.0.1 hadoopSúbor teraz vyzerá takto:

Pohybujúci sa Hadoop

Čas využiť používateľa hadoop, ktorého sme vytvorili skôr, a prideliť tomuto používateľovi vlastníctvo tohto súboru:

chown -R hadoopuser: hadoop / root / hadoopLepším umiestnením pre Hadoop bude adresár / usr / local /, takže ho tam presunieme:

mv hadoop / usr / local /cd / usr / local /

Pridávanie Hadoopu do cesty

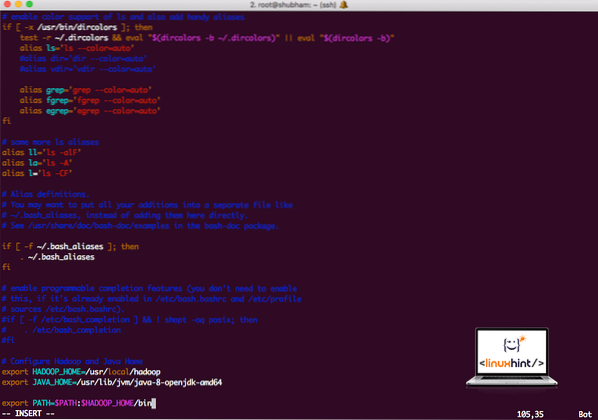

Aby sme mohli vykonávať skripty Hadoop, pridáme ich teraz na cestu. Ak to chcete urobiť, otvorte súbor bashrc:

vi ~ /.bashrcPridajte tieto riadky na koniec súboru .súbor bashrc, aby táto cesta mohla obsahovať cestu k spustiteľnému súboru Hadoop:

# Konfigurujte Hadoop a Java Homeexportovať HADOOP_HOME = / usr / local / hadoop

exportovať JAVA_HOME = / usr / lib / jvm / java-8-openjdk-amd64

export PATH = $ PATH: $ HADOOP_HOME / bin

Súbor vyzerá takto:

Pridávanie Hadoopu do cesty

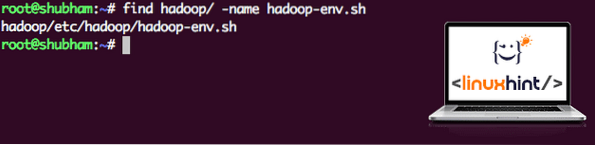

Pretože Hadoop využíva Javu, musíme povedať súbor prostredia Hadoop hadoop-env.š kde sa nachádza. Umiestnenie tohto súboru sa môže líšiť v závislosti od verzií Hadoop. Ak chcete ľahko zistiť, kde sa tento súbor nachádza, spustite nasledujúci príkaz priamo mimo adresára Hadoop:

nájsť hadoop / -name hadoop-env.šZískame výstup pre umiestnenie súboru:

Umiestnenie súboru prostredia

Upravme tento súbor, aby sme informovali Hadoop o umiestnení Java JDK, a vložte ho do posledného riadku súboru a uložte ho:

exportovať JAVA_HOME = / usr / lib / jvm / java-8-openjdk-amd64Inštalácia a nastavenie Hadoop je teraz hotové. Teraz sme pripravení spustiť našu vzorovú aplikáciu. Ale počkajte, nikdy sme nepodali vzorovú žiadosť!

Spustenie ukážkovej aplikácie s programom Hadoop

Inštalácia Hadoop v skutočnosti prichádza s vstavanou vzorovou aplikáciou, ktorá je pripravená na spustenie po dokončení inštalácie Hadoop. Znie to dobre, správne?

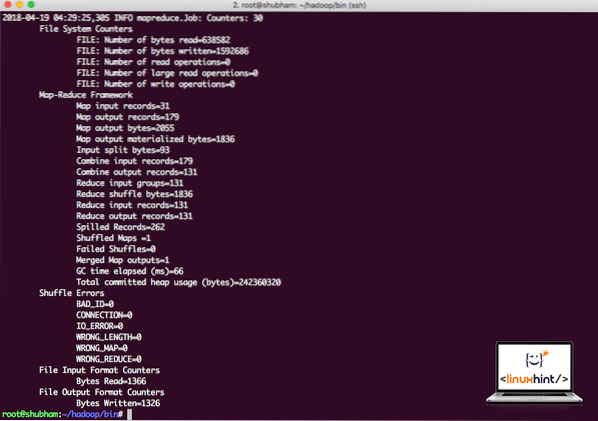

Spustením nasledujúceho príkazu spustíte príklad JAR:

hadoop jar / root / hadoop / share / hadoop / mapreduce / hadoop-mapreduce-examples-3.0.1.jar wordcount / root / hadoop / README.txt / root / výstupHadoop ukáže, koľko spracovania vykonal v uzle:

Štatistiky spracovania Hadoop

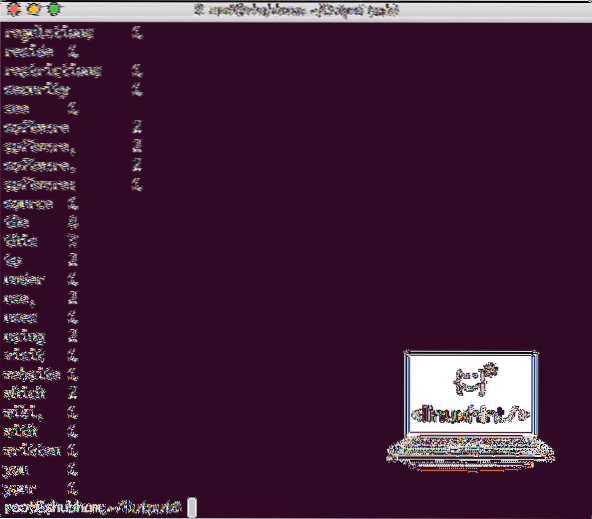

Po vykonaní nasledujúceho príkazu sa nám ako výstup zobrazí súbor part-r-00000. Pokračujte a pozrite sa na obsah výstupu:

mačka časť-r-00000Dostanete niečo ako:

Počet slov vydaný programom Hadoop

Záver

V tejto lekcii sme sa pozreli na to, ako môžeme nainštalovať a začať používať Apache Hadoop na Ubuntu 17.10 stroj. Hadoop je vynikajúci nástroj na ukladanie a analýzu veľkého množstva dát a dúfam, že vám tento článok pomôže rýchlo ho začať používať v Ubuntu.

Phenquestions

Phenquestions